前言

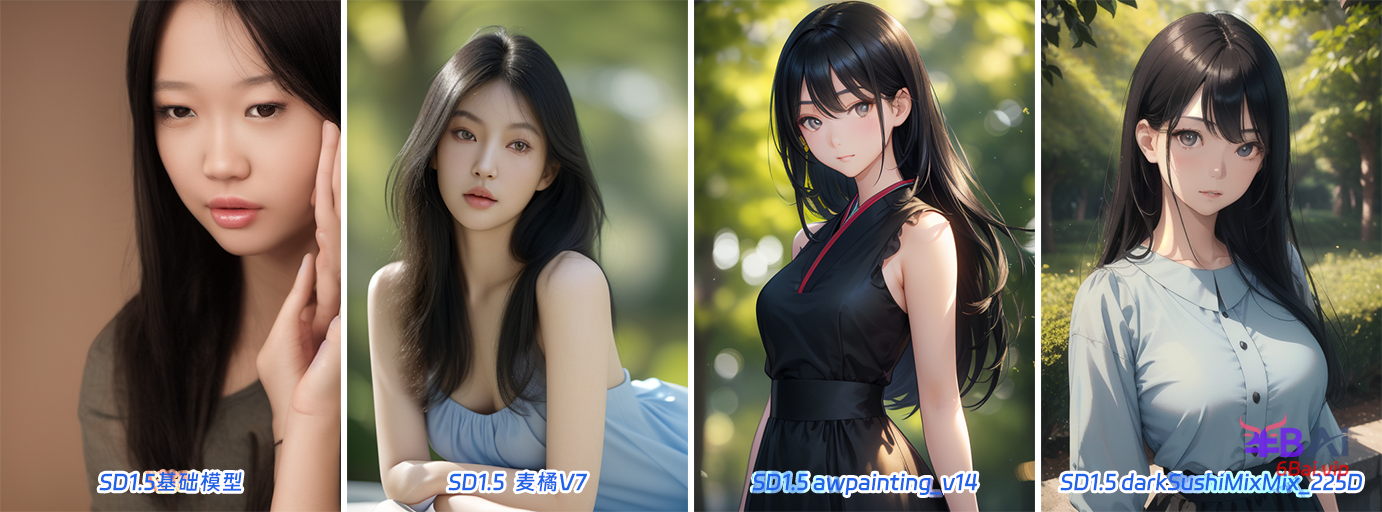

在开始之前,先尝试使用同一组提示词,生成多张图像来做一个对比。

提示词(提示词由Deepseek R1自动生成):

(best quality,highres,masterpiece),ultra-detailed,(realistic,photorealistic,photo-realistic),1girl,Asian young woman,black hair,dark eyes,soft smile,casual dress,light blue fabric,elegant posture,upper body shot,front view,gentle expression,long flowing hair,bright eyes,detailed skin texture,simple background,park setting,blurred trees,natural colors,soft daylight,portrait photography,professional lighting,HDR,UHD,studio lighting,sharp focus,vivid colors,bokeh译文:

(最高品质、高清、杰作),超精细(逼真、超写实、照片级写实),1 个女孩,亚洲年轻女子,黑色长发,深色眼睛,温柔微笑,休闲装,浅蓝色面料,优雅姿态,上半身特写,正面视角,温和表情,长发飘逸,明亮眼睛,细致皮肤纹理,简洁背景,公园场景,模糊树木,自然色彩,柔和日光,肖像摄影,专业照明,HDR,超高清,工作室照明,清晰对焦,鲜艳色彩,虚化效果

对比结果(以下图像均为随机抽取,未经任何人工筛选):

通过上述对比会发现,使用完全相同的提示词,在不同的模型中的表现完全不尽相同。在ai模型百花齐放的今天,首先得学会如何区分模型,以便快速的筛选出合适自己的模型。

模型分类

图像生成基础底模

基础底模是ai生图中最重要,也必须有的模型,基础底模与之前提到过的Unet本质可以算是同一个概念,不同的是Unet是一个神经网络架构,众多ai训练团队基于这个基础架构,训练出了独特能力表现的模型,他们在将模型无私的分享开源出来。随着时间的推移,和不同团队的发力,形成了百家争鸣的现状。既越早的模型、训练集(参数量)越小的模型,能力表现可能越差,当然这不完全绝对,以中立的角度来看,不同模型都各有自己的优势与劣势。

目前主流的开源模型主要有:

- SD1.5

全称Stable Diffusion 1.5是由Stability AI发布的1.X版本中表现最为优先的模型之一。

网盘下载:https://pan.quark.cn/s/5d41088a6bf5

- SDXL

全称Stable Diffusion XL同样是由Stability AI发布。

网盘下载:https://pan.quark.cn/s/5f33cb6f0e2a

- SD3.5

还是Stability AI发布的模型,生不逢时,热度和生态支持一定程度上弱于Flux模型。

- Flux

由Black Forest Labs(黑森林实验室)发布的第一款开源模型。

网盘下载:https://pan.quark.cn/s/99b805c6de66

- Qwen-Image

由国内阿里旗下,通义千问团队开源发布的图像生成模型。

视频生成基础底模

- Wan2.1

由阿里旗下通义万象团队开源的视频模型。

- Wan2.2

同样是由阿里旗下通义万象团队开源的视频模型,Wan2.1的升级迭代版。

微调模型

微调模型是指基于底模,进行全量二次训练的模型。通常是由社区第三方团队,或个人根据特殊场景/需求/爱好等多方面原因,基于某个版本的官方模型,进行二次训后后的模型。举一个不太恰当的例子,基础底模就好像是毛坯房一样,微调模型就是全屋定制装修,对整栋有一个比较统一的风格进行装修。这就是开源模型的优势,不需要完全自己去从0开始训练基础模型。

Lora模型

除了微调模型之外,还有一种非常类似于微调模型的,就是Lora模型。还是以盖房子为例,如果微调模型是全屋定制装修,Lora模型就如同一栋楼里面,你会根据自己的喜好,把你住的那间房子完全按照自己的风格进行装修。

模型下载

模型下载网站

模型下载渠道众多,当前主流的模型。通常可以在huggingface存储库或开源模型社区进行下载,C站目前主流的国外开源社区模型下载网站。

huggingface:https://huggingface.co

上述平台需要代理访问和下载,很多时候并不是那么方便,除此之外还有一些国内镜像存储库,和国内的模型分享社区。

更多下载渠道⬇⬇⬇

认识模型与筛选

不同的平台通常都有自己的筛选机制,以便快速的定位到模板模型。通常的筛选方式是通过站内搜索,或者平台提供的筛选工具进行筛选。

这里以C站为例:

评论(0)